社区热点太散盯不过来?用 Community Scout + AI Agent 搭一个开发情报流

社区热点太多,不是信息不够,而是你没法每天筛一遍

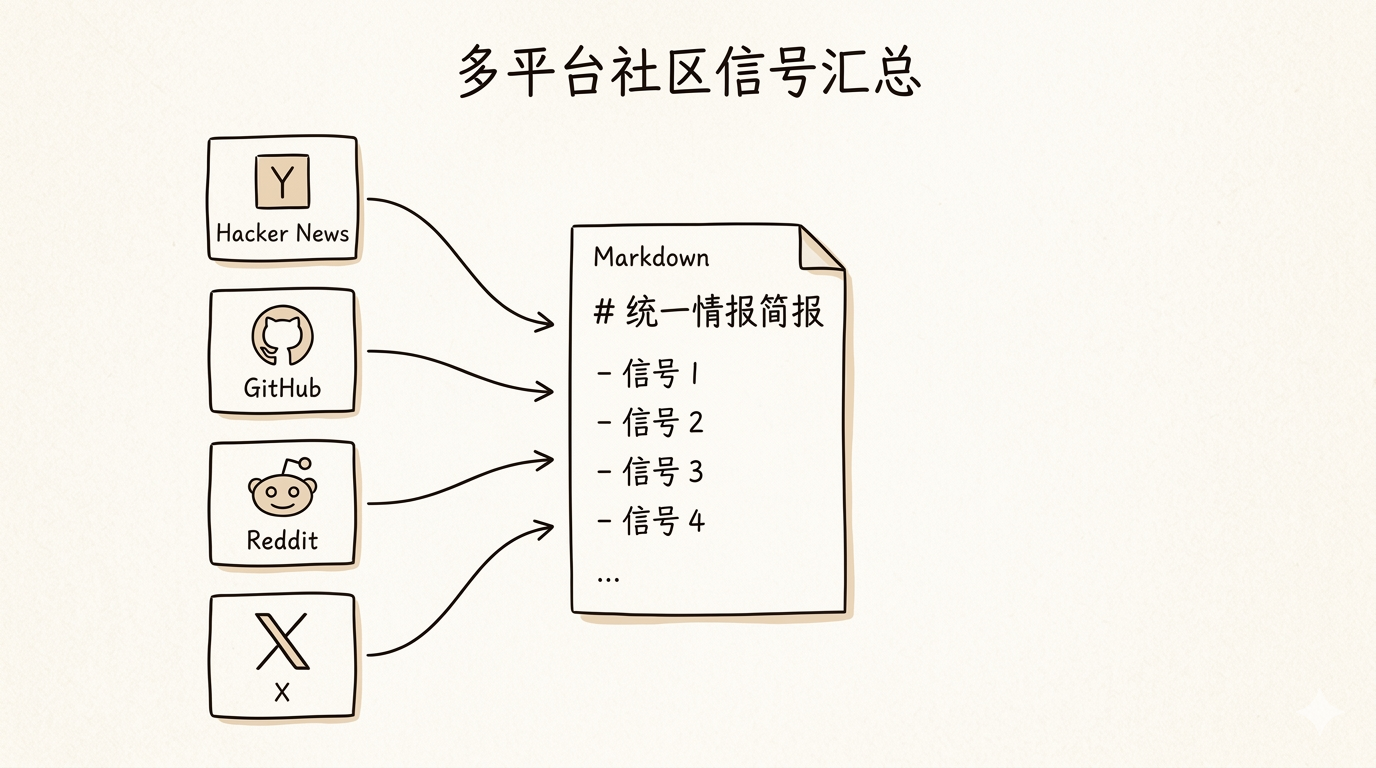

如果你平时会盯 Hacker News、GitHub Trending、Reddit、X,那应该很熟悉一种低效感:消息很多,但真正值得你跟进的没几条。

更麻烦的是,这些内容分散在不同平台。你要么一个个点进去看,要么开一堆 RSS、Bot、收藏夹,最后变成“信息都看了,但没有真正沉淀成行动”。

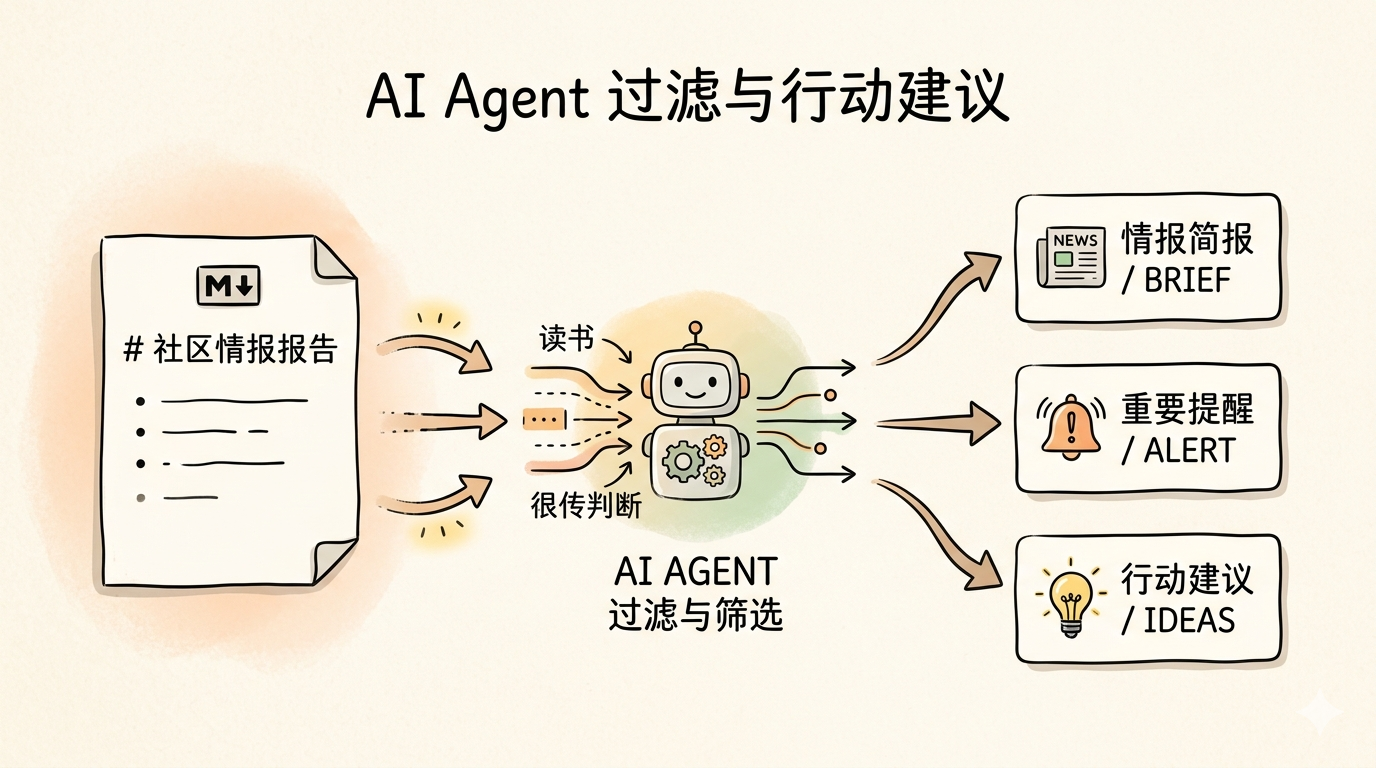

Community Scout 值得写,不是因为它又抓了几个网站,而是它把这件事拆成了更适合 AI 工作流的两段:先统一抓原始信号,再交给 Agent 做筛选和总结。对做内容选题、产品监控、技术情报、竞品观察的人来说,这个思路比“再加一个订阅源”更实用。

先讲结论:Community Scout 不是情报结论器,而是情报原料机

这个项目的定位很直接:

AI-powered dev community intelligence. Monitors Reddit, Hacker News, GitHub Trending, and X/Twitter.

但它真正有价值的点,不是“监控 4 个平台”,而是只负责把原始数据抓下来,输出成 Agent 友好的纯文本报告。

也就是说,它不试图替你做复杂的产品判断,而是把流程切成两层:

community-scout.sh负责抓取与落盘- 你的 AI Agent 负责按你的兴趣、业务和目标做二次过滤

这个结构很适合个人开发者和小团队,因为它天然支持你继续往后接:

- 晨报摘要

- 爆款选题池

- 竞品跟踪

- 安全风险提醒

- 新工具发现清单

它到底抓什么?4 个平台 + 1 个占位入口

根据 README 和脚本本身,Community Scout 当前会处理这些来源:

- Hacker News:从 top stories 里筛 AI / agent 相关主题,或者高分内容

- GitHub:抓最近 7 天创建、且有一定 star 的仓库,再做关键词过滤

- Reddit:默认看

ClaudeAI、LocalLLaMA、moltbot,同时还会跑几组站内搜索 - X / Twitter:通过 xAI 的

x_search能力抓最近 7 天相关帖子 - Product Hunt:脚本里先留了入口,但当前只是标记“structured data 需要 API key”

这几个源的组合很像一个开发者日常会手动刷的最小闭环:

- HN 适合看讨论热度

- GitHub 适合看新项目和工具爆发点

- Reddit 适合看真实使用反馈

- X 适合看新品首发、作者观点和传播动向

如果你做的是 AI 工具、自动化工作流、热点监控,这几个源基本已经覆盖了“早发现 + 早判断”的核心需求。

为什么这个项目适合接 AI Agent,而不是自己做一堆规则?

关键在于它输出的是纯文本 markdown 报告。

README 里强调 Plain text output,跑完后结果会落到临时文件,脚本版默认是按日期生成 markdown 报告。这样做有 3 个很实际的好处。

1)对 Agent 最友好,不需要额外解释 JSON 结构

很多监控工具的问题不是抓不到,而是抓完以后输出一坨结构化字段,最后你还得自己再写一层解析逻辑。

Community Scout 反过来,直接把结果组织成可读的 markdown 段落和条目。对 Claude Code、OpenClaw、Clawdbot 这类会读文件的 Agent 来说,接入门槛非常低:让它读文件,再让它给结论。

2)抓取和判断解耦,后续更容易改

今天你可能只想看 AI Agent 和 MCP;明天你可能想换成投研、开源情报、竞品舆情。

如果规则全写死在采集脚本里,每次都要改抓取层。现在这种设计更轻:脚本只负责把原料拿回来,真正的“ relevance 判断 ”交给模型层做。

这意味着你可以很自然地切出不同下游工作流:

- 给自己做“每天只看 5 条最值得关注的信息”

- 给公众号做“潜在选题池”

- 给产品经理做“竞品和讨论动向摘要”

- 给安全团队做“高风险依赖或舆情提醒”

3)特别适合 cron 和无人值守

README 直接给了定时执行示例:

1 | |

这意味着它天然不是一个“手动打开看一眼”的玩具,而是一个可以被塞进日常工作流的组件。

如果你已经在用 Claude Code 的定时能力、n8n、LaunchAgent 或 OpenClaw 的自动任务,这种脚本型工具就很好接。

10 分钟上手:最小可用流程怎么搭

如果你只是想先跑通,不需要一上来就折腾复杂自动化。

README 给出的最小路径非常短:

1 | |

跑完以后,README 写的是输出会落到 /tmp/community-scout-*.md 这类报告文件里;如果你直接照脚本当前实现看,默认输出目录是它在脚本里配置的日期型 markdown 报告路径。

你接下来只要做一件事:让 Agent 去读它。

比如可以给 Agent 一个非常简单的任务:

- 读取最新 scout 报告

- 只保留和 AI 工作流 / MCP / 本地模型 / 自动化工具相关的内容

- 按“值得现在跟进”的程度排序

- 输出 Top 5,并补一句为什么值得看

这时候,Community Scout 才真正发挥价值:它不是替你做判断,而是给你的 Agent 提供更完整的输入面。

真正值得抄的,是它的工作流分层

我觉得这个项目最值得借鉴的,不是 Reddit、HN 或 GitHub 的抓取细节,而是下面这条链路:

1 | |

README 里的 agent integration 例子已经把思路写得很清楚:

- 检查报告目录里有没有新文件

- 按你的兴趣做 relevance 打分

- 只把高于阈值的内容放进 morning briefing

这套结构其实可以直接迁移到很多中文场景:

场景 1:做公众号或内容选题

你可以把“值得写”的标准提前写给 Agent,例如:

- 必须能落成教程

- 必须和 AI 工具 / 工作流 / 信息监控有关

- 不能只是融资新闻

- 不能和近 7 天文章重复

然后每天自动从报告里筛出 1 到 3 个候选,再让模型继续深挖一手资料。

场景 2:做个人技术雷达

很多独立开发者不是不知道信息在哪,而是没有能力持续筛。

Community Scout 这种模式可以把“刷社区”从一个消耗注意力的动作,变成一个每天固定产出的输入源。你真正处理的是结论和行动项,不是网页本身。

场景 3:做竞品和趋势观察

如果你有明确关注的关键词,比如 MCP、Agent、语音模型、开源 IDE、自动化运营,就能直接改脚本里的 subreddit、keyword、X query,把它变成一个更窄、更有信噪比的监控器。

它的边界也很明显,别把它想成全能系统

这个项目目前更像一个轻量骨架,而不是完整平台。

几个边界你要提前知道:

- X 依赖 xAI API key,没有就会跳过,但其他源照样能跑

- Product Hunt 目前只是预留入口,不是完整结构化抓取

- 配置主要靠改脚本头部,不是可视化后台

- 最终价值高度依赖你的 Agent 提示词是否清楚

换句话说,它不能替你定义“什么叫重要”。

但这反而是优点,因为“重要”这件事本来就强依赖你的目标:

- 做内容的人关注能不能转成实战文章

- 做产品的人关注是否值得跟进功能方向

- 做投研的人关注是否能形成结构化观察

- 做自动化的人关注是否能接进已有任务流

Community Scout 只做第一步:把原料捞上来。

如果你已经在用 OpenClaw / Claude Code,这篇项目最该怎么用?

我更推荐你把它当成一个上游情报采集器,而不是终点工具。

比较顺手的一条链路可以是这样:

community-scout.sh定时跑- 生成最新报告

- Agent 读取报告,打 relevance 分数

- 高分内容进入一个候选池

- 只有候选池里的内容,才继续做深度研究、写作或提醒

这样你就不会把模型预算浪费在“全网都看看”这种低价值动作上,而是把模型算力留给真正需要判断的环节。

对公众号、技术博客、产品观察者来说,这个思路尤其值钱:先用脚本做广覆盖,再用 Agent 做高价值收缩。

总结

如果你现在的问题是“信息太多、每天盯盘太累、却又不想错过值得跟进的新工具和趋势”,那 Community Scout 值得你花 10 分钟试一下。

它不花哨,也不是那种一眼惊艳的全栈产品,但胜在结构简单、接入门槛低,而且非常适合继续往 AI 工作流里扩。

你可以把它理解成一个很轻的前置过滤器:

- 帮你把多个社区的原始信号拉平

- 帮 Agent 拿到更完整的输入

- 最终把“刷信息”变成“收结论”

这类工具最大的价值,从来不是多抓一个站点,而是让你终于不用再靠自己每天手动刷完整个互联网。

如果文章对你有帮助,欢迎点击上方按钮打赏作者,更多功能请访问博客站

支付宝打赏

支付宝打赏  微信打赏

微信打赏